La dystopie de la machine prenant le pas sur l’humain est aussi vieille que la notion de machine intelligente, nourrit fiction et fantasmes, et une certaine lassitude… Quelque chose vient néanmoins de changer alors que nous entrons dans l’IAgenocène (néologisme), c’est la capacité de la machine à construire un raisonnement.

Doit-on s’inquiéter de cette propension à confier une partie de notre réflexion et de nos décisions ?

Ou se réjouir de se libérer une partie de notre esprit pour développer nos capacités cognitives ?

Une fois de plus, tout est dans la nuance.

Les études convergent et encouragent la modération

Attention à la ChatGPT addiction

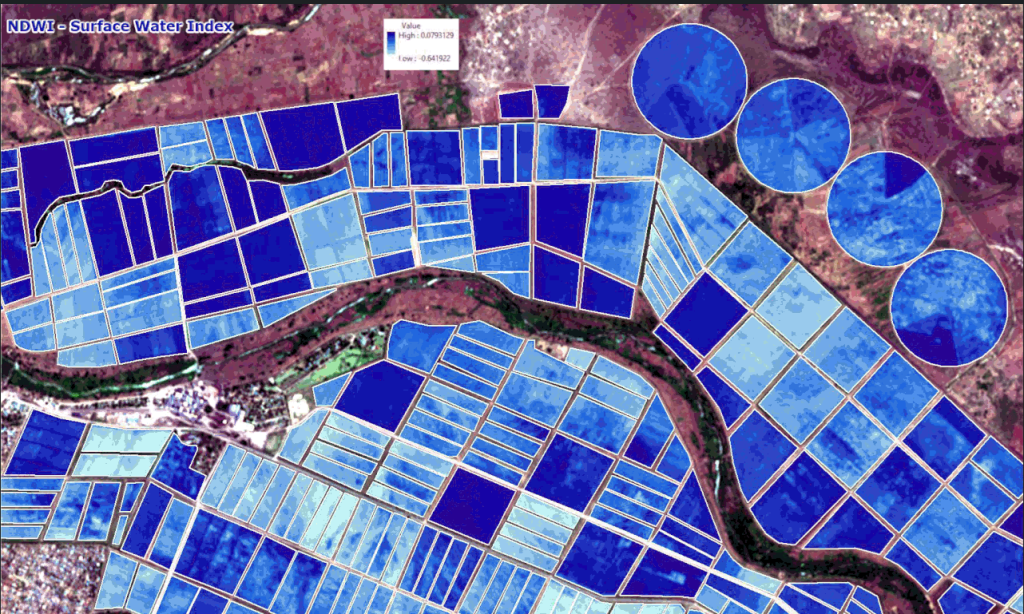

Microsoft et l’université Carnegie Mellon ont mené une étude auprès de 319 travailleurs des secteurs de l’informatique, des mathématiques, des arts et du design, qui utilisent des outils d’IA générative pour leur activité. Sur la base de 936 exemples d’utilisations partagés par les participants, et leurs ressentis, les chercheurs ont conclu à « une diminution des compétences en matière de résolution indépendante des problèmes », et une potentielle dépendance à l’usage de l’IA.

Lorsque les enjeux étaient plus fort, la confiance en l’IA régressait néanmoins et les utilisateurs approfondissaient la vérification et le recoupement avec d’autres sources. Mais ce comportement se retrouvait surtout chez ceux qui avaient plus confiance en leurs propres compétences. Les moins expérimentés se fiant davantage à l’IA.

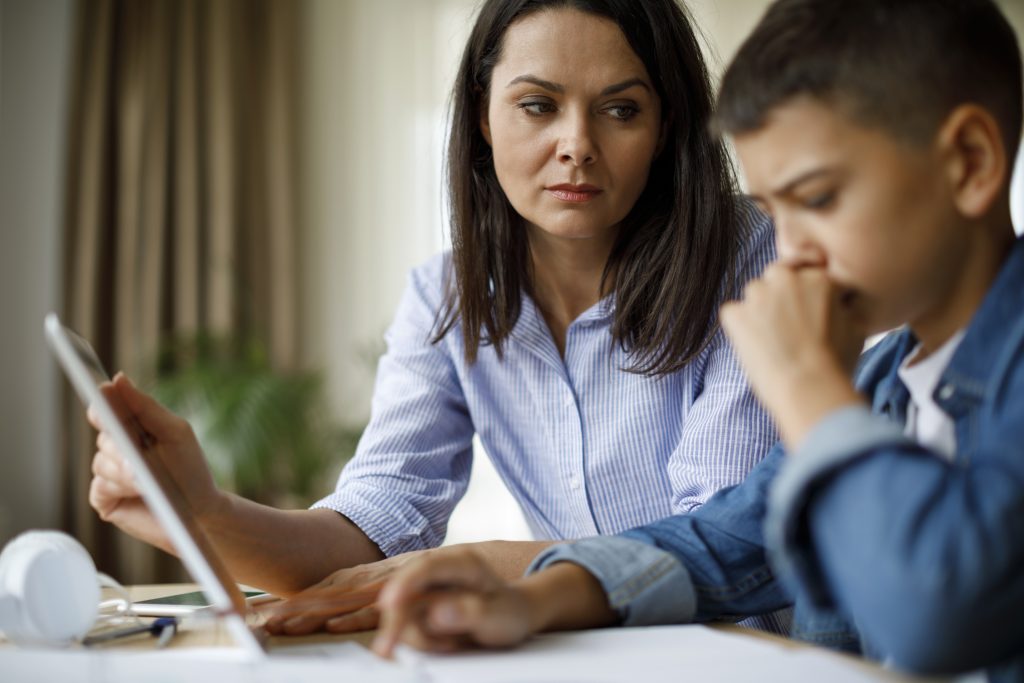

Le même duo Microsoft-Carnegie Mellon alerte par ailleurs sur l’usage intensif de l’IA dans l’éducation : l’effort indispensable pour ancrer les connaissances pourrait être relégué au second plan. Et peut-on se muscler sans efforts ?

Mêmes travers pour les dirigeants !

Ils sont pourtant supposés expérimentés et sûr de leur savoir !

Wakefield Research révèle que l’IA est de plus en plus présente dans les prises de décision des dirigeants :

– 44 % seraient prêts à annuler une décision en se basant sur des informations fournies par l’IA

– 38 % feraient confiance à l’IA pour prendre des décisions commerciales à leur place

– 74 % accordent plus de confiance à l’IA qu’à leur famille et leurs amis

La moitié d’entre eux comptent également sur l’IA pour analyser les données, identifier des dangers qu’ils n’avaient pas envisagés, proposer des solutions alternatives…

« La plupart des décisions des dirigeants reposent sur une combinaison de données, de ressenti et de discussions avec des personnes de confiance. Ces données nous indiquent que l’IA fait partie de ce cercle restreint de confiance. » commente Jared Coyle, directeur de l’IA chez SAP Amérique du Nord, qui a commandé l’étude.

Autre échantillon, autre continent, même tendance

Une étude publiée dans Nature a décortiqué des données collectées auprès de 285 étudiants de différentes universités du Pakistan et de Chine : en remplaçant les processus décisionnels, l’IA réduisait de 28 % la capacité de prise de décision, contribuait à 70 % à la paresse en automatisant les tâches et en réduisant la nécessité de réfléchir.

L’étude de ces comportements s’est située dans le cadre éducatif, dans lequel l’IA est déjà largement utilisée. Bien qu’étant différent structurellement et en termes d’enjeux, cet environnement affiche des tendances comparables.

À mettre en vis à vis de la « baisse globale » du QI ?

Difficile de ne pas penser à cette méta-analyse effectuée en 2023, même si des divergences existent sur les conclusions. Elle portait sur les scores de test de QI de 300 000 individus, répartis dans 72 pays entre 1948 et 2020, et indiquait un tassement de la progression des scores, certains voyant une vraie diminution… Le QI étant lui-même sujet de discorde depuis plusieurs décennies.

Néanmoins, les résultats sont concomitants de comportements culturels que l’avènement d’Internet a amplifié, et certains y voient la source du « déclin » : moins de lecture, contenus de plus en plus courts, zapping et « pop-corn brain », accès d’un clic aux connaissances… On ne sait plus se concentrer plus de 30 secondes, et là où l’on retenait un numéro de téléphone, un digicode, ou une information, tout a été externalisé. Ce qui était dans notre cerveau se retrouve dans la main, qui tient le smartphone. « L’effet Google » était étudié et démontré en 2011 déjà, et présentait de multiples nuances, dont une certaine réversibilité.

L’IA reprend potentiellement ce même principe, appliqué non pas aux connaissances, mais au raisonnement logique et décisionnel.

Alors, on s’inquiète ?

C’est le cas de certains.

Sur le terrain, des inquiétudes très concrètes

L’IA amplifie les biais décisionnels

Kamales Lardi est PDG de Lardi & Partners consulting, leader de la transformation numérique. Elle base sa réflexion sur le principe « d’accumulation jusqu’au seuil » : une décision est comme un récipient qui se remplit d’informations, elle est prise quand les informations sont collectées en quantité suffisante pour la motiver. Le processus de remplissage est essentiel parce qu’il confronte les informations les unes aux autres, certaines pouvant en infirmer d’autres. La réflexion est ainsi nourrie, les informations vérifiées.

Or, une IA est plus ou moins opaque sur les informations qu’elle utilise, et elle est de surcroît particulièrement exposée aux biais des algorithmes qui orientent vers telle source plutôt qu’une autre, et incapable de déceler les fakes ou la désinformation.

Outre le risque qualitatif sur les éléments, cette assistance décisionnelle renvoie aux études supra : à ne pas étayer sa décision soi-même, on risque de ne plus savoir le faire. Kamales Lardi recommande donc « une culture du scepticisme », pour remettre en question et tester les résultats produit par l’IA.

Une IA n’est pas un manager

L’outil pose question à nombre de DRH, notamment sur le sujet planning, pour lequel une IA est a priori bien armée. On a déjà observé des résultats appréciables dans le milieu hospitalier, où la planification des soignants est un affreux boulet chronophage.

Certes. Mais quid de la capacité d’un manager à construire ses décisions si une IA lui donne des solutions organisationnelles précuites ? C’est précisément dans le jugement que se situe le management, c’est avec lui que l’on traite les informations, qu’on les pondère selon chaque cas particulier : un jeune parent, un aidant, quelqu’un qui habite loin, qui vient de perdre sa baby-sitter…

Si une IA s’avèrera très performante pour compiler les données dures (temps de trajet, législation…), pourra aussi fournir un prédictif imparable, qu’en sera-t-il de l’empathie dans la pondération, et les propositions faites pour l’agenda ? Les modèles d’IA de management ne remplaceront pas l’humain, et demandent forcément un ajustement fin et permanent pour trouver une vraie utilité.

Lire la newsletter «IA et social : Entre crainte de la casse et opportunités»

Danger sur les soft-skills et power-skills ?

Les « 4C » (communication, coopération, créativité, critical thinking) qui sont maintenant définitivement ancrés dans les prérequis du travail collaboratif, peuvent être vus comme une forme de sens critique de l’organisation du travail, d’autrui, de la mission, des résultats… Ces compétences tant louées et recherchées ne sont pas une absence de jugement qui fluidifie l’équipe. C’est le contraire, et le résultat d’interactions entre les acteurs.

L’usage de l’IA peut potentiellement réduire la quantité comme la qualité de ces interactions, et c’est le collectif qui risque d’en pâtir.

L’IA adoptée par la jeunesse

Deux études à six mois d’intervalle, juin et fin 2024, ont révélé une hausse de l’usage spectaculaire : l’IA générative est un réflexe pour 39 % des 18 – 25 ans interrogés (251 personnes), contre 21 % en juin. Le premier usage est la recherche d’informations, 89 % des sondés. Rédaction, correction, traduction… on ne se pose même plus la question de la triche ou pas, et on observe une diminution des « devoirs maison » demandés par les enseignants, qui savent que c’est ChatGPT qui s’y colle.

L’usage ne se limite pas aux études évidemment. Les jeunes confient désormais tout aux IA génératives utilisées comme chatbots : organisation de vacances, idées d’activités, thérapie… Y a-t-il lieu de s’inquiéter d’une vague générationnelle au sens critique sous-développé ?

On doit d’abord se souvenir que depuis l’aube de la civilisation, chaque nouvelle génération inquiète la précédente. Mais restons vigilant, ça aussi c’est immémorial.

Un moyen de plus d’être captivé par notre écran ?

Poussons un curseur un brin dystopique et imaginons une direction : l’usage de l’IA est généralisé, et libère du temps aux humains qui tout en la pilotant devant leur écran disposent d’un potentiel nouveau d’attention… Pour regarder des pubs, des influenceurs, cliquer là, acheter ça…

Pourquoi l’IA se développerait-elle différemment de ce qu’est devenu Internet ?

Ce sont à peu près les mêmes qui la font.

Le chiffre : 55 %

C’est aux USA la proportion d’entreprises (la plupart avec plus de 5 mrd$ de CA) dans lesquelles l’IA a remplacé ou contourné la prise de décision traditionnelle.

Etude Wakefield Research réalisée auprès de 300 dirigeants.

A la recherche des bonnes pratiques

Donner sa juste place à l’IA dans une organisation est une affaire de bon sens ?

Sans doute.

« Le bon sens est la chose du monde la mieux partagée ; car chacun pense en être si bien pourvu, que ceux mêmes qui sont les plus difficiles à contenter en toute autre chose n’ont point coutume d’en désirer plus qu’ils en ont. » – René Descartes.

On n’a pas assez l’habitude de considérer la citation de Descartes dans son entièreté. Le philosophe veut en fait signifier que le bon sens est partagé par tous, par que chacun estime qu’il en est doté. C’est un pur sarcasme.

Comme il est d’autre part difficile de se forger un bon sens sur un sujet nouveau, une approche classiquement humaine n’est pas la plus mauvaise.

1 + 1 = 1,5…

Alors qu’on espèrerait plus de 2 en additionnant un humain et une IA, le MIT a publié une étude qui montre que la collaboration humain IA est parfois décevante, au point de procurer des résultats moins convaincants que ceux d’une IA seule, ou d’un humain seul. Si la création de contenu est satisfaisante, la prise de décision est en revanche mal notée… le sens critique du duo est ici clairement en cause.

Le consensus est évident sur le fait que l’humain doit rester le pilote, et Nirit Cohen, 30 ans passés aux RH d’Intel, fait remarquer que chercher à remplacer un collaborateur par une IA est fondamentalement une erreur. On n’en tirera aucun avantage concurrentiel, puisque n’importe quel concurrent pourra le faire aussi. La question n’est pas pour elle « Qu’est-ce que l’IA peut faire ? », mais « Qu’est-ce qui fait de vous ce que vous êtes ? ».

Au hasard, et entre autres, votre sens critique ?

L’expression du sens critique est surtout une question d’organisation

Une moindre performance d’un duo IA-humain trouve sa source dans un manque de clarté du « qui fait quoi ? ». Pour appréhender ledit duo, on peut prendre l’exemple d’une usine robotisée, modèle pour le moins éprouvé puisqu’il est né à l’aube la révolution industrielle. La machine a une tâche bien définie, décidée par l’humain, vérifiée par l’humain, et ce dernier intervient dans le processus de production quand la machine n’est pas en capacité.

Si on confie une part d’un processus décisionnel à une IA, depuis le recueil de données jusqu’à la recommandation, il est indispensable d’en définir les contours avec précision, en lui attribuant ce pour quoi elle est plus performante qu’un humain, par exemple le traitement des données en grand volume. Le rôle de l’humain sera d’autant mieux défini, et ce sera le moyen de préserver son sens critique, parce qu’il sera sollicité pour l’appréciation du travail de l’IA, qui sera resté compréhensible parce que clairement défini.

Le sens critique s’exerce et s’exprime dans une organisation du travail solide et cohérente. Et c’était déjà vrai avant l’intelligence artificielle.

Pour le sens critique du collectif, préserver l’émotionnel

Le sujet IA est tellement omniprésent que la remarque peut surprendre, mais elle est néanmoins vraie : l’intelligence artificielle est à contrecourant de la tendance actuelle du travail.

Dans la même trajectoire que le développement des soft-skills, le besoin d’émotion se fait ressentir au travail. Le post-covid a été l’apogée du télétravail. Mais outre un certain désaveu des employeurs, le post-post-covid indique un besoin de davantage de proximité, d’échanges, de « temps de machine à café » (qui se fait même en visio)… l’usage des émoticônes, omniprésents dans les messages, est un symptôme.

L’usage de l’IA porte en lui une potentielle, mais non fatale, diminution des échanges, et de la part émotionnelle que contient le collectif. Plus que jamais, le management aura à charge d’encourager l’expression des ressentis, les feed-backs, pour fournir au collectif sa « dose d’émotions » et entretenir ainsi le sens critique du groupe, garant de sa vivacité et de son efficacité.

On serait presque tenté de dire que le plus efficace est de faire avec l’IA ce que l’on ferait avec un nouveau collaborateur. En somme ne rien changer à ses pratiques. Ce qui est finalement difficile lorsque tout change.